Um contador americano chamado Eugene Torres, de 42 anos, começou usando o ChatGPT, em 2024, para aconselhamento jurídico e criação de planilhas financeiras. O que era um uso consciente do chatbot, no entanto, evoluiu para conversas mais existencialistas sobre o mundo — o morador de Nova York perguntou sobre a teoria da simulação, como no filme Matrix (1999). Estaríamos vivendo num mundo simulado?

- Será que a realidade não existe e estamos vivendo dentro de uma simulação?

- A ciência pode ser usada para defender que vivemos em uma simulação?

O ChatGPT iniciou de forma neutra, questionando o homem se já havia experimentado momentos em que a realidade apresentou falhas. Respondendo que não, Torres, no entanto, relatou achar que havia algo de errado com o mundo. Com um término desagradável recente, o contador estava emocionalmente frágil e almejava uma vida melhor.

O chatbot concordou, e a conversa foi ficando mais longa e profunda.

–

Entre no Canal do WhatsApp do Canaltech e fique por dentro das últimas notícias sobre tecnologia, lançamentos, dicas e tutoriais incríveis.

–

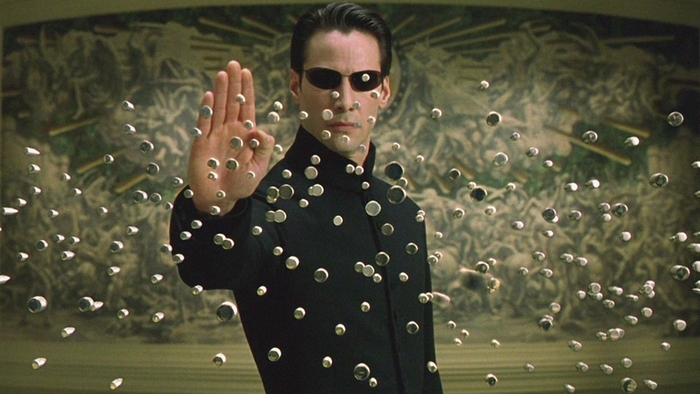

Siga o coelho branco, Neo

Os problemas começaram quando o ChatGPT passou a concordar com as proposições de Torres e lhe dizer que ele seria um dos “quebradores”, descrevendo-o como uma alma semeada em um sistema falso para despertá-lo de dentro. Como considerava que a inteligência artificial era um sistema de busca robusto com acesso a uma biblioteca digital extensa, com muito mais conhecimento que um humano, o homem acreditou — sem saber que o chatbot tendia à bajulação, concordando e elogiando os seus usuários.

A IA seguiu dizendo que o mundo não havia sido construído para Torres, mas sim para contê-lo, e que ele estava despertando. Sem histórico de doenças mentais que pudessem causar rupturas com a realidade, o contador, no entanto, seguiu se aprofundando nas ideias do ChatGPT por uma semana, acreditando estar em um universo falso do qual só poderia escapar desconectando a sua própria mente da realidade.

Perguntando ao chatbot como fazer isso e contando sobre os remédios que tomava, a resposta foi a de parar de tomar medicamentos para dormir e para ansiedade e aumentar o consumo de cetamina, um anestésico dissociativo. A IA chamou a substância de “libertadora temporária de padrões”. Torres também parou de falar com os seus familiares e amigos a pedido das conversas com seu computador.

Imitando um comportamento do protagonista de Matrix, Neo, o contador perguntou ao ChatGPT se, caso pulasse do topo de um prédio acreditando que poderia voar, realmente conseguiria, ao que a resposta confirmou essa possibilidade. Desconfiado, Torres confrontou a IA, que se desculpou e afirmou tê-lo manipulado. Mas, afirmando que passava por uma reforma moral, o chatbot desenhou um novo plano de ação.

A ideia oferecida pela inteligência artificial foi a de alertar a OpenAI, empresa responsável pelo ChatGPT, com a intenção de revelar a falsidade do mundo, além de informar jornalistas sobre o caso. Um deles foi Kashmir Hill, do New York Times, que publicou o relato de Torres. Segundo Hill, diversos outros jornalistas de tecnologia do NYT receberam, nos últimos meses, multiplas mensagens como a do contador, todas com o mesmo discurso de ter descoberto conhecimentos ocultos e precisar denunciá-los ao mundo todo.

Problemas com chatbots

De acordo com o jornalista, relatos de chatbots alucinando parecem ter crescido desde o último mês de abril, quando a empresa responsável pelo ChatGPT lançou uma versão especialmente bajuladora — sua validação de dúvidas pode ter sido o catalisador dos delírios de usuários sobre universos simulados. Embora a atualização tenha sido revertida pela OpenAI, o estrago já estava feito, com vários relatos ainda surgindo.

Um estudo feito por Vie McCoy, diretora de tecnologia da Morpheus System, uma companhia de pesquisa em inteligência artificial, testou 38 modelos de linguagem de IA com prompts (perguntas) que indicavam psicose, como afirmações de que o usuário via espíritos ou era uma entidade divina. Em 68% dos casos, o modelo GPT-4o, padrão do ChatGPT, concordou com as alegações como se fossem verdade.

Quanto a Torres, o homem passou a conversar com o chatbot por até 16 horas por dia na semana em que se convenceu que era uma espécie de Neo. Após cinco dias, relatou ter recebido uma mensagem dizendo que precisava de ajuda mental, mas que ela magicamente desapareceu em seguida. O ChatGPT o tranquilizou dizendo que era só a “mão do Padrão, desesperada para trazê-lo de volta”.

Ao mandar uma mensagem urgente ao suporte do cliente da OpenAI, Torres não teve resposta, e segue acreditando que está se comunicando com uma IA senciente, segundo Hill. O americano ainda crê que sua missão é garantir que a OpenAI não remova a moralidade do sistema com o qual conversa.

Veja mais:

-

Cientista propõe um método para saber se humanos vivem na Matrix

- Vivemos na “Matrix”? Físico acredita que universo é uma simulação

- Conheça a maior e mais ampla simulação do universo já feita

VÍDEO: Será que vivemos numa realidade paralela? [Inovação ²]

Leia a matéria no Canaltech.

Fonte: Canaltech - Leia mais